사용자는 애플리케이션을 배포하기 위해 컨테이너를 끌어다 실행하기만 하면 애플리케이션을 단 몇 분만에 배포할 수 있어 시스템 관리자는 애플리케이션을 서비스하고 유지 보수하는 대신 미션 크리티컬 작업에 집중할 수 있다.

지난 3 년 동안 컨테이너는 공유 클러스터에 응용 프로그램을 배포하고 작업 속도를 높이고 특히, AI 작업에 연구원 및 데이터 과학자에게 중요한 도구가 되었다. 이러한 컨테이너는 심층 신경 네트워크를 설계, 교육 및 검증하는 블록을 보다 빠르고 쉽게 개발할 수 있는 딥러닝 프레임 워크를 구축한다.

사용자는 이제 엔비디아 GPU 클라우드(NGC)의 35 가지 학습, 고성능 컴퓨팅 및 시각화 컨테이너를 활용할 수 있게 됐다. 24일부터 28일(현지시각)까지 독일 프랑크푸르트에서 개최되는 국제 슈퍼 컴퓨팅 컨퍼런스(ISC High Performance 2018)에서 엔비디아는 GPU 가속화 고성능 컴퓨팅 및 인공지능(AI) 개발을 가속화하기 위한 일환으로 작년에 출시된 엔비디아 GPU 클라우드(이하 NGC)에서 제공되는 컨테이너의 수를 세 배 이상 늘렸다고 밝혔다.

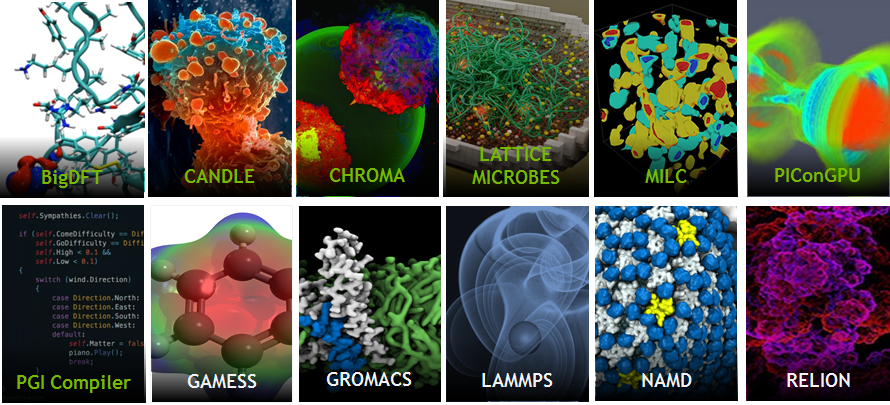

프레임 워크 설치는 복잡하고 많은 시간이 소요된다. 컨테이너는 이 프로세스를 단순화하므로 사용자는 간단한 끌어 오기 및 실행 명령으로 최신 응용 프로그램 버전에 액세스 할 수 있다. 새로운 NGC 컨테이너에는 CHROMA, CANDLE, PGI 및 VMD를 포함한 9 개의 새로운 HPC 및 시각화 컨테이너가 NGC에 추가됐다.

NGC에서 사용할 수 있는 PGI 컴파일러용 컨테이너는 개발자가 멀티 코어 CPU 및 엔비디아 테슬라 GPU(NVIDIA Tesla GPU)를 대상으로 HPC 애플리케이션을 개발하는 데 도움이 된다. 또한 PGI 컴파일러 및 도구를 사용하면 OpenACC, OpenMP 및 CUDA Fortran 병렬 프로그래밍을 사용하여 휴대용 HPC 응용 프로그램을 개발할 수 있다.

또한 컨테이너에 대한 필요성은 딥러닝에만 국한되지 않는다. 슈퍼 컴퓨팅은 모든 세그먼트에 걸쳐 애플리케이션의 배치를 단순화해야 하는 상황으로 거의 모든 슈퍼 컴퓨팅 센터에서 환경 모듈을 사용하여 애플리케이션을 구축, 배포 및 시작하기 때문으로 시간 소모적이고 비생산적인 접근 방식으로, 며칠이 걸릴 수 있다. 이러한 설치의 복잡성으로 인해 사용자는 최신 기능에 액세스하고 최적화된 성능을 발휘할 수 없게 된다.

이에 컨테이너 공유 시스템에서 애플리케이션 배포 간소화는 훌륭한 대안이 된다. 설치가 제거되므로 아무도 환경 모듈 연결을 추적하거나 해제할 필요가 없으며, 사용자는 애플리케이션을 배포하기 위해 컨테이너를 끌어다 실행하기만 하면 애플리케이션을 단 몇 분만에 배포할 수 있어 시스템 관리자는 애플리케이션을 서비스하고 유지 보수하는 대신 미션 크리티컬 작업에 집중할 수 있다.

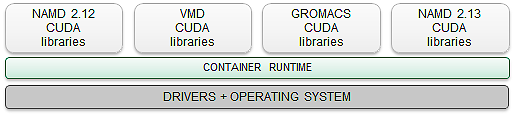

컨테이너의 추가적인 주요 이점은 재현성과 휴대성을 제공한다는 것으로 사용자는 애플리케이션을 설치하지 않고도 다양한 시스템에서 워크 로드를 실행할 수 있으며, 이와 동등한 시뮬레이션 결과를 얻을 수 있다. 또한 NGC 컨테이너 내의 애플리케이션은 CPU 시스템보다 훨씬 우수한 성능을 제공하는 GPU 가속화 기능을 제공한다. 사용자는 최신 버전의 HPC 애플리케이션에 액세스 할 수 있으며, 딥러닝 프레임 워크 컨테이너는 매월 전체 소프트웨어 스택에서 업데이트되고 최적화되어엔비디아 GPU에서 최고의 성능을 제공한다.

한편 이러한 컨테이너는 GPU 기반 워크스테이션, NVIDIA DGX 시스템 및 원활한 사용자 환경을 위해 아마존 웹 서비스(AWS), 구글 클라우드 플랫폼 및 오라클 클라우드 인프라(Oracle Cloud Infrastructure, OCI) 등 클라우드 서비스 제공 업체와 NVIDIA GPU를 포함한 다양한 시스템에서 테스트된다.