도시바, 딥러닝 활용해 고정밀도, 저비용으로 거리측정 실현...로봇피킹, 무인배송차 자율이동 등과 드론 원격조작을 통한 인프라 점검 등에 활용

최근 로봇에 의한 물품 픽업 및 공장의 무인반송차(AGV) 등과 자율 무인항공기(UAV Unmanned aerial vehicle)의 원격 조작에 의한 인프라 점검 등 다양한 분야에서 이미지 센싱의 중요성이 증가하고 있다.

이러한 용도로는 피사체의 이미지를 촬영뿐만 아니라 소형 장치의 모양과 거리 정보 등의 3 차원 정보의 파악이 요구되고 있다. 이러한 요구에 비용 및 공간 절감이 가능하고 소형화에 적합한 단안(single-eyed) 카메라를 이용한 계측 기술의 개발에 관심이 집중되고 있다.

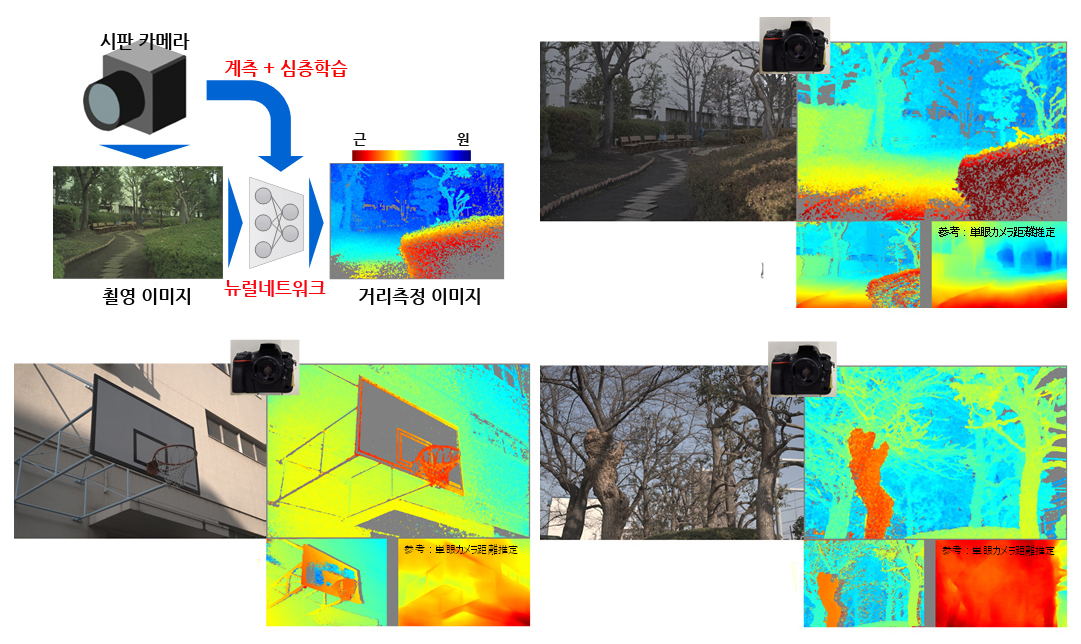

이 가운데 도시바가 딥러닝을 통해 피사체의 형상과 배경 등의 정보를 학습하고 거리를 추정하는 단안 카메라(상용 카메라)로 촬영한 이미지를 AI를 통해 스테레오 카메라 수준으로 정밀 거리 측정을 실현하는 '입체 인식 AI'를 개발했다.

일번적인 단안 카메라에 의한 거리 추정 기술의 정밀도는 학습한 풍경(風景) 정보에 의존하기 때문에 학습한 풍경 정보와 다른 배경으로 촬영하면 정확도가 현저하게 저하하는 단점이 있었다. 2 가지 색상 필터를 렌즈에 꽂아 피사체까지의 거리에 따라 발생하는 이미지의 색상과 크기를 분석함으로써, 풍경 정보에 의존하지 않고 거리를 추정하는 컬러 개구(Aperture) 촬영 기술을 개발했지만 기존 렌즈의 개조에 따른 비용과 노력이 과제가 되고 있었다.

따라서 도시바는 딥러닝을 사용하여 렌즈의 위치에 따라 이미지가 어떻게 흐려지는지(흐릿한 모양) 분석함으로써 스테레오 카메라와 같은 고정밀 거리 측정을 실현하는 입체 인식 AI를 개발한 것이다.

지금까지는 이론적으로 초점 위치에서 등거리라면 원근점 어느 지점에서도 블러(blur)의 모양이 같아지기 때문에 피로 형상에서 거리를 측정하는 것은 어렵다. 그러나 실제로 블러의 모양을 분석해보니, 초점 위치에서 등거리라도 원근각의 지점에서 블러의 모양에 큰 차이가 있는 것으로 나타났다. 따라서 심층신경망 모델을 학습하는 딥러닝을 통해 촬영된 이미지에서 흐림 정보를 분석하는 데 성공했다.

학습 과정에서 예측한 거리와 실제 거리의 오차를 작게하도록 네트워크를 업데이트 한다.

한편 도시바는 '입체 인식 AI'를 활용한 결과, 시판 카메라 촬영 이미지에서 스테레오 카메라에 필적하는 정확한 거리 측정을 실현할 수 있는 것을 확인했다고 밝혔다.