日 후지쯔연구소가 AI에 증대되는 연산 수요에 대응 연산정밀도를 자동으로 제어하고 고속화하는 '컨텐츠 인식 컴퓨팅(Content- Aware Computing)' 기술을 개발했다. 이 기술은 GPU · CPU 클라우드, 엣지 등 다양한 환경에서도 AI 처리의 빠른 실행이 가능하다

최근 AI 기술의 발전과 보급에 따라 이미지 인식 및 음성 번역 등에 활용 또한 넓어지고 있다. 그것을 실현하기 위한 AI 처리의 연산량이 폭발적으로 증가하고 있으며, AI 용도로 개발된 GPU 또는 전용 프로세서 등이 이용되고 있다.

또한 클라우드 환경에서 에지 컴퓨팅까지 용도에 맞게 다양한 환경에서 AI 연산이 이루어지고 있다. 앞으로 더욱 증가될 AI의 연산량에 대해 고속으로 처리할 수 있는 기술이 필요한 시점이다.

이에 日후지쯔연구소(Fujitsu Laboratories)가 AI에 증대되는 연산 수요에 대응하는 연산정밀도를 자동으로 제어하고 고속화하는 '컨텐츠 인식 컴퓨팅(Content- Aware Computing)' 기술을 개발했다. 이 기술은 GPU · CPU 클라우드, 엣지 등 다양한 환경에서도 AI 처리의 빠른 실행이 가능하다

일반적으로 AI 처리의 고속화를 위해서는 전문가가 연산 정밀도의 전환 부분 등을 데이터나 실행 환경별로 조정해야 했지만 이번 기술은 학습의 정도에 따라 최적의 연산 정밀도를 자동으로 제어하고 속도 외에도 클라우드 등과 실행 시간에 격차가 있던 병렬 환경에서 일부 노드의 연산 지연을 방지하고 연산 속도를 안정화시킬 수 있다.

후지쯔는 이 기술을 딥러닝에 적용하여 계산 능력을 최대 10 배 향상시킬 수 있었으며, 향후 더욱 증가하는 AI 활용의 요구에 대응할 것이라고 한다.

예를 들어, 딥러닝 알고리즘인 신경망의 연산에서 32 비트의 연산 정확도를 8 비트로 떨어뜨려 4 배 병렬 연산을 함으로써 고속화를 실현하는 방법도 있지만, 일률적으로 연산 정확도를 떨어뜨려 연산 결과가 저하된다.

따라서 연산 정확도 조정은 어느 곳의 연산 정확도를 떨어뜨리고 어느 곳의 연산 정확도를 떨어뜨리지 않는지를 인력으로 정하고 있었다. 그러나 이러한 방식은 조정에 시간이 걸리고 또한 입력 데이터와 실행 환경이 바뀌면 조정을 다시 시작해야 하는 과제가 있었다.

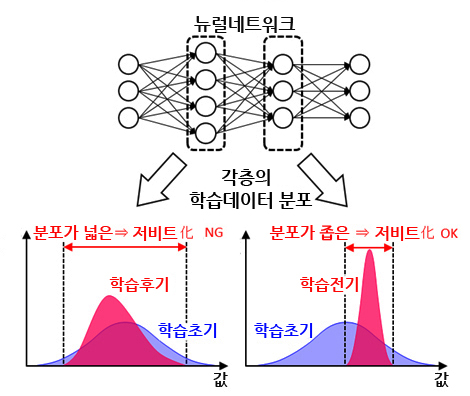

개발된 기술은 데이터에 맞게 비트 수를 자동으로 줄이는 기술로 일반적으로 신경망은 학습이 진행되면 각 층의 수치 범위가 비슷한 수치로 수렴해 가는 성질이 있다. 이 특성을 활용해 계산 중 신경망의 각 계층의 수치 범위 분포를 기반으로, 분포가 넓은 계층에서 높은 비트, 분포가 수렴된 계층에서 낮은 비트와 같이 학습 상황에 따라 연산 정확도의 적용 정도를 결정한다. 이를 통해 연산 결과의 열화를 억제하면서, 딥러닝에 적용할 경우 기존의 3 배까지 속도를 높일 수 있다.

결론적으로 이번에 개발한 기술을 활용함으로써 AI 처리를 최대 10배까지 빠르게 할 수 있으며, 이 기술을 AI 프레임워크와 라이브러리에 통합하면 저비트 연산 기능이 통합된 GPU ·CPU와 이를 이용한 클라우드 및 데이터 센터에서의 AI 처리를 자동으로 고속화할 수 있는 것이다. 또 이미 보급된 AI 프레임워크에 통합하고 딥러닝을 이용한 AI 서비스의 실행 기반으로 활용할 수 있다.