구글의 버트, T-Brain의 KoBERT에 이은 ‘KoGPT-2’는 한국어로 학습된 오픈소스 기반 모델으로 챗봇 구축, 텍스트 감성 예측, 텍스트 분석 기반 응답 생성 등에

2018년 구글이 공개한 버트(BERT, Bidirectional Encoder Representations for Transformers)는종래보다 우수한 성능을 발휘한다. BERT는 자연언어 처리 태스크를 교육 없이 양방향으로 사전 학습하는 첫 시스템이기 때문이다. '교육 없음'이란 BERT가 보통의 텍스트 말뭉치만을 이용해 훈련되고 있다는 것을 의미한다. 이것은 웹(Web) 상에서 막대한 양의 보통 텍스트 데이터가 여러 언어로 이용 가능하기 때문에 중요한 특징으로 꼽는다.

또한 SK텔레콤의 T-Brain이 지난해 10월 개발 공개한 코버트(KoBERT)는 기존 BERT의 한국어 성능 한계를 극복하기 위해 개발되었다. 위키피디아나 뉴스 등에서 수집한 수백만 개의 한국어 문장으로 이루어진 대규모말뭉치(corpus)를 학습하였으며, 한국어의 불규칙한 언어 변화의 특성을 반영하기 위해 데이터 기반 토큰화(Tokenization) 기법을 적용하여 기존 대비 27%의 토큰만으로 2.6% 이상의 성능 향상을 이끌어 냈다.

대량의 데이터를 빠른시간에 학습하기 위해 링 리듀스(ring-reduce) 기반 분산 학습 기술을 사용하여, 십억 개 이상의 문장을 다수의 머신에서 빠르게 학습한다. 더불어, 파이토치(PyTorch), 텐서플루(TensorFlow), ONNX, MXNet을 포함한 다양한 딥러닝 API를 지원함으로써, 많은 분야에서 언어 이해 서비스 확산에 기여하고 있다.

여기에 28일, 아마존웹서비스(AWS)와 SK텔레콤이 협력해 최초의 한국어로 학습된 오픈소스 기반 모델인 ‘KoGPT-2(Generative Pretrained Transformer-2)’을 공개했다.

‘GPT-2’는 머신러닝 알고리즘을 활용해 입력된 샘플 텍스트를 분석해 구문론적, 문법적, 정보적 일관성을 갖춘 텍스트로 완성하고 생성하는 자연어 처리(NLP) 모델이다. 한국어로 학습된 오픈소스 기반의 ‘GPT-2’ 모델인 ‘KoGPT-2’는 일반적인 질문에 대한 응답 생성, 문장 완성, 챗봇 등 한국어 해석이 요구되는 광범위한 애플리케이션의 머신러닝 성능을 향상시킬 수 있다.

개발자들은 ‘KoGPT-2’를 직접 사용하거나 추가 학습을 함으로써 보다 적은 자원과 자연어 처리 지식으로도 대규모 언어 모델 학습과 같은 자연어 처리 업무를 보다 빠르게 처리할 수 있게 됐다. ‘KoGPT-2’는 챗봇 구축, 텍스트 감성 예측, 텍스트 분석 기반 응답 생성에 사용될 수 있다.

SK텔레콤은 자사의 사회적 미션의 일환으로 머신러닝 커뮤니티 성장에 기여하기 위해 ‘KoGPT-2’를 공개하기로 결정했다고 밝혔다.

AWS와 SK텔레콤은 협력을 통해 양사의 자연어 처리 전문 지식과 대규모 학습 경험을 기반으로 ‘KoGPT-2’ 모델을 학습시켰다. SK텔레콤이 제공한 한국어 데이터셋을 활용함으로써 양사는 고도로 효율적인 환경에서 한국어 모델을 개발하고 학습시켰다.

AWS 고객들의 머신러닝 사용 가속화를 돕는 프로그램인 아마존 머신러닝 솔루션즈 랩(Amazon Machine Learning Solutions Lab)과 AWS의 딥러닝 팀은 SK텔레콤과 함께 아마존 EC2(Amazon EC2), 아마존 S3를 위한 고성능 공유 파일 시스템 서비스인 아마존 ‘FSx for Lustre’ 등 AWS 서비스를 활용해 효율적인 대규모 학습 환경을 구축하고 조율했다.

AWS 팀은 새로운 자연어 처리용 오픈 소스 기반 딥러닝 인터페이스인 글루온(Gluon) NLP를 활용해 SK텔레콤의 학습 과정을 가속시켰다. 또한 더 적은 수의 GPU를 사용해 더 빠르게 ‘KoGPT-2’ 모델을 학습했다.

미셸 리(Michelle Lee) AWS 아마존 머신러닝 솔루션즈 랩 부사장은 “‘KoGPT-2’와 같은 고급 언어 모델 개발을 위해서는 많은 양의 학습 데이터, 상당한 양의 컴퓨팅 자원, 자연어 처리에 대한 전문 지식이 필요하다”면서, “AWS는 고성능 컴퓨팅 기반의 가장 폭넓고 깊이 있는 ML 서비스를 제공해 한국 고객들의 문제 해결, 디지털 혁신 가속화, 고객 서비스 강화, 비즈니스 최적화, 완전히 새로운 고객 경험 창출을 달성할 수 있도록 지속적으로 지원할 것”이라고 말했다.

에릭 데이비스(Eric Davis) SK 텔레콤 글로벌 AI 개발그룹장은 “머신러닝은 디지털 전환을 촉진할 수 있는 잠재적인 가능성으로 인해 국내에서 많은 관심을 받고 있지만, 대부분 기업들이 ‘KoGPT-2’ 모델과 같은 대규모 모델 개발에 어려움이 있었다”며, “SK텔레콤은 ‘KoGPT-2’가 노년층을 위한 챗봇, 코로나19와 관련된 가짜 뉴스 차단을 위한 검색 엔진 등 한국어를 해석하는 혁신적인 애플리케이션을 개발하는 중소기업과 스타트업의 기술 역량 발전에 이바지할 수 있기를 바란다”고 말했다.

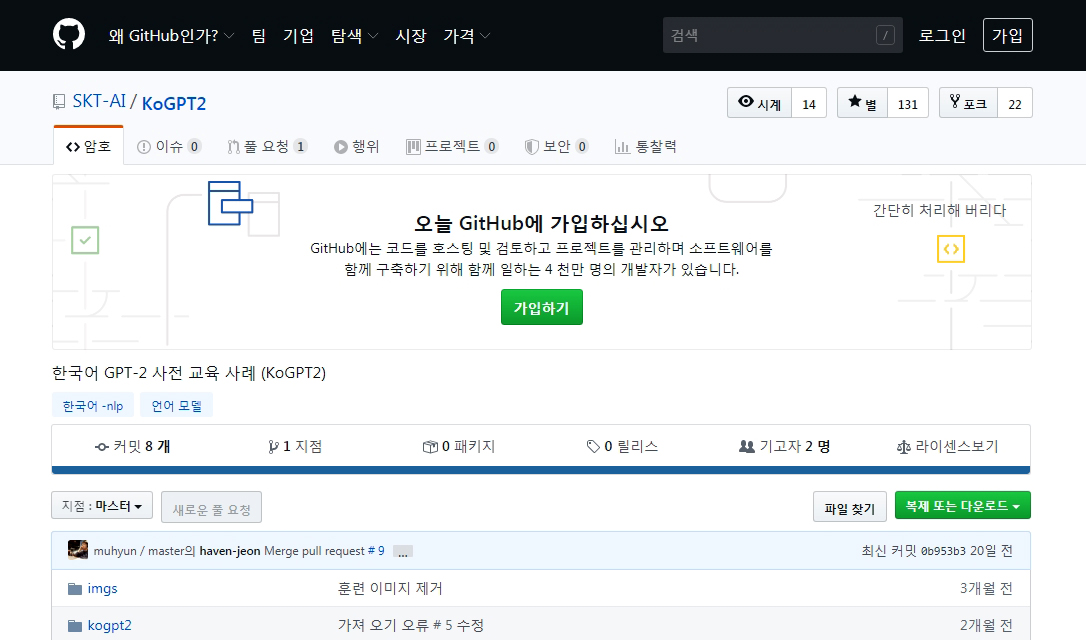

한편, ‘KoGPT-2’는 수정 MIT 라이선스(Modified MIT License) 아래 SKT AIX 센터의 깃허브(다운)에서 다운로드할 수 있다. 관심 있는 개발자는 모델과 관련 소스를 다운로드해 프로젝트에 자유롭게 사용, 수정 및 적용할 수 있다.