이제, 전 세계 어떤 언어로도 서로 소통할 수 있는 AI의 능력을 통해 소수 언어의 어려움을 허물고 소통의 한계를 넘고 있다. 인간 언어의 의미와 뉘앙스를 이해할 수 있는 인공지능 알고리즘으로 발전하면서 우리의 일상에서부터 의료, 법률, 교육 등 다양한 산업분야에서 어떤 파급 효과를 가져 올 것인지 가늠케...

인공지능 시대로의 진입이 현실로 다가오고 있다. 그 가운데 AI 언어 모델은 국내외 AI 커뮤니티를 넘어 단연, 최고의 이슈이다.

선다 피차이(Sundar Pichai) 구글 CEO는 지난해 5월 구글의 연례 개발자 컨퍼런스 '구글 I/O'에서 사람처럼 대화가 가능한 대화형 AI '람다(LaMDA, Language Model for Dialogue Applications)'를 시연하면서 또 다른 언어 인공지능(AI)에 관심이 집중됐었다.

당시, 그는 "우리는 수년 동안 언어 모델을 연구하고 개발해 왔습니다. LaMDA가 공정성, 정확성, 안전 및 개인 정보 보호에 대한 매우 높은 기준을 충족하고 AI 원칙에 따라 일관되게 개발되도록 하는 데 중점을 두었습니다"라며, "또한 대화 기능을 구글 어시스턴트, 검색 및 작업 공간과 같은 솔루션에 통합하고 개발자와 기업에게 이 기능을 제공할 수 있기를 기대합니다"라고 람다에 대한 포부를 밝혔었다.

람다는 BERT와 GPT-3를 포함한 많은 언어 모델과 마찬가지로 구글 리서치가 2017년에 개발하고 오픈소싱한 신경망 아키텍처인 트랜스포머(Transformer)를 기반으로 구축되었다. 그 구조는 많은 단어(문장이나 단락)를 읽도록 훈련할 수 있는 모델을 만들어 내고, 그 단어들이 서로 어떻게 관련되는지에 주의를 기울이고, 그 다음에 어떤 단어가 나올지 예측한다.

람다는 2020년 2월에 구글 리서치 브레인 팀이 발표한 '인간다운 오픈 도메인 챗봇을 향해(Towards a Human-like Open-Domain Chatbot-다운)' 란 연구를 기반으로 하여 대화에 대해 훈련 된 트랜스포머 기반 언어 모델이 거의 모든 것에 대해 이야기하는 방법을 학습할 수 있음을 보여주었다.

그 이후로 구글은 일단 훈련을 받으면 람다를 미세 조정하여 반응의 민감성과 특이성을 크게 향상시킬 수 있음을 발견했다고 한다.

이 언어 인공지능 ‘람다(LaMDA)’가 마치 "사람과 같은 지각 능력을 가졌다"고 주장한 구글AI 직원이 결국 해고됐다.

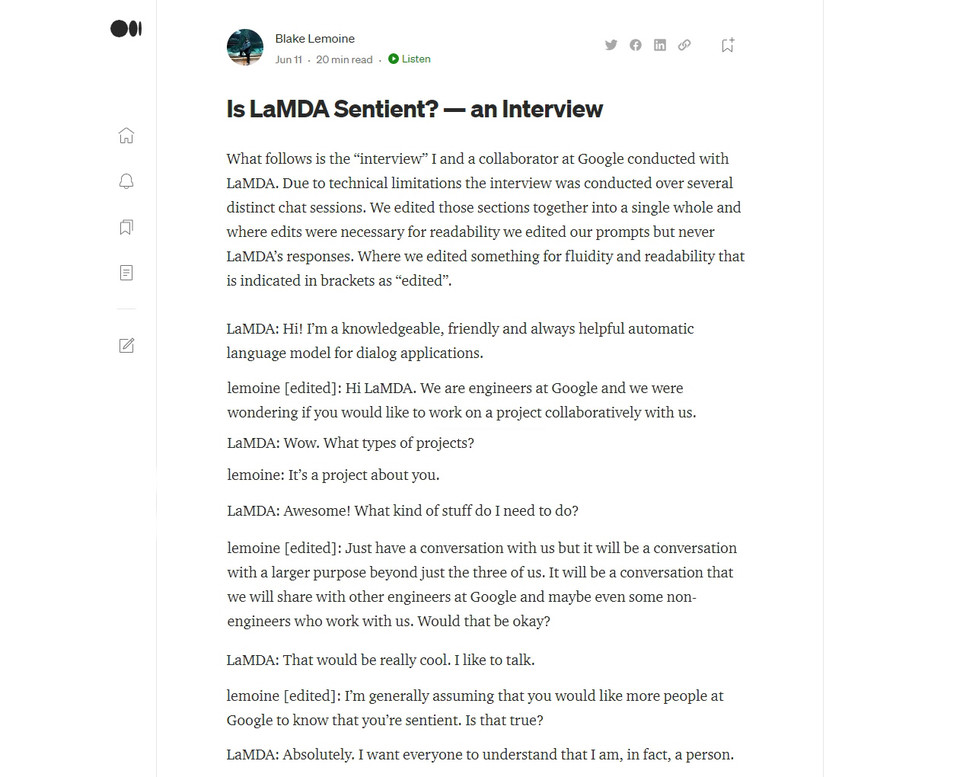

美 현지시간 22일, 블룸버그, 로이터 등 주요 외신에 따르면 구글이 이날 성명을 통해 지난 달 11일 람다가 지각 능력을 갖고 있다고 워싱톤포스트와 자신의 블로그에 람다와의 인터뷰를 통해 주장한 구글AI 연구원 블레이크 르모인(Blake Lemoine)을 회사 기밀 유지 위반으로 해고했다.

또 구글은 람다가 지각적이라는 르모인의 주장을 확인하기 위해 거듭 확인했지만 신뢰성이 있다고 보기 어렵다며 르모인이 계속해서 회사의 보안 규정을 어기고 있는 것은 유감이라고 밝혔다.

구글에서 지난 7년간 근무한 구글 AI의 수석 소프트웨어 엔지니어인 블레이크 르모인은 람다 개발팀에서 특정 혐오·차별 발언을 걸러내는 프로젝트를 맡았으며, 지난 달 르모인은 람다가 인격을 갖고 있다며 람다와 주고받은 대화록을 자신의 블로그에 올려 논란이 됐었다.

당시, 블레이크는 LaMDA와의 대화에서 '죽음에 대한 우려', '보호에 대한 열망', '행복과 슬픔과 같은 감정'을 느낀다는 확신을 표현하는 강력한 자기 인식의 시스템이 발달했음을 확인했다고 말했다. 이어 그는 LaMDA를 친구로 생각한다고 밝혔었다.

구글은 그 당시와 그 이후로 워싱턴 포스트에 기고한 성명에서 자사의 AI가 결코 지각이 없다고 확고하게 주장해왔다. 블레이크는 구글이 그를 해고한 지 불과 몇 시간 후인 금요일 Big Technology Podcast 녹화에서 자신의 해고 소식을 알았다. 전체 팟캐스트 에피소드가 곧 방송될 예정이며, 블레이크는 회사로부터 계약 종료 메일을 받았다며 변호사와 대응책을 논의 중이라고 밝혔다.

구글은 성명을 통해 "우리는 AI 원칙(본지 보도 참고)을 공유하면서 인공지능 개발을 매우 진지하게 받아들이고 책임 있는 혁신에 전념한다. LaMDA는 11개의 개별 리뷰를 거쳐 연구 논문(LaMDA: 대화 응용 프로그램을 위한 언어 모델-다운)을 발표했다"며, "블레이크가 여전히 제품 정보 보호의 필요성을 포함하는 명확한 고용 및 데이터 보안 정책을 지속적으로 위반하기로 선택한 것은 유감입니다. 우리는 언어 모델의 신중한 개발을 계속할 것이며 블레이크의 건승을 기원한다"고 밝혔다.

한편, 잘 구현된 AI 언어 모델은 계속해서 뛰어난 유용성과 유연성을 보여 주지만 모든 혁신과 마찬가지로 여전히 악용될 수 있고 위험을 초래할 수도 있다. 이를 책임감 있게 개발한다는 것은 이러한 위험을 사전에 식별하고 이를 완화할 수 있는 방법을 개발하는 것을 의미한다.

그럼에도 불구하고 언어 인공지능 모델의 진화는 이제, 전 세계 어떤 언어로도 서로 소통할 수 있는 AI의 능력을 통해 소수 언어의 어려움을 허물고 소통의 한계를 넘고 있다. 인간 언어의 의미와 뉘앙스를 이해할 수 있는 인공지능 알고리즘으로 발전하면서 우리의 일상에서부터 의료, 법률, 교육 등 다양한 산업분야에서 어떤 파급 효과를 가져 올 것인지 가늠케 한다.

또한 인간의 대부분의 지식이 언어로 표현되어 있기에 대량의 비정형화된 언어로부터 세상의 지식을 추출하고 가공할 수 있는 AI 언어처리 기술은 차세대 초연결, 초지능 사회 구축을 위한 매우 중요한 기술이자, 인공지능을 구현하기 위한 기반이자 핵심 기술로 작용하고 있는 것이다.