젬마는 매개변수 ‘2B’와 ‘7B’ 두 가지 모델로 정교한 멀티모달 추론 기능을 갖춘 대화형 생성 AI '제미나이' 기술 및 인프라 구성 요소를 공유하고 기존 오픈 모델에서 동급 최고의 성능을 발휘... 개발자용 노트북이나 데스크톱 컴퓨터에서 직접 실행, 주요 벤치마크서 훨씬 더 큰 모델을 능가..

구글이 생성 AI 생태계의 무한 확장에 나섰다. 구글은 21일(현지시간) 인공지능(AI) 개발자와 연구자 등을 위한 동급 최고의 초경량화(sLLM) 모델 '젬마(Gemma)'를 오픈 소스로 공개했다.

라틴어로 ‘보석’을 뜻하는 젬마(Gemma)는 '제미나이(Gemini)‘ 모델과 동일한 연구 및 기술을 기반으로 책임감 있는 AI 개발을 위해 제작되었으며, 이날부터 전 세계에서 사용할 수 있다.

공개된 젬마는 매개변수 ‘20억(2B)’와 ‘70억(7B)’ 두 가지 모델로 정교한 멀티모달 추론 기능을 갖춘 대화형 생성 인공지능(Generative AI) '제미나이' 기술 및 인프라 구성 요소를 공유한다. 또, 젬마는 기존 오픈 모델에서 동급 최고의 성능을 발휘할 수 있다고 한다.

무엇보다도, 젬마는 개발자용 노트북이나 데스크톱 컴퓨터에서 직접 실행할 수 있으며 안전하고 책임감 있는 AI 배포에 대한 엄격한 기준을 준수하면서 주요 벤치마크에서 훨씬 더 큰 모델을 능가한다.

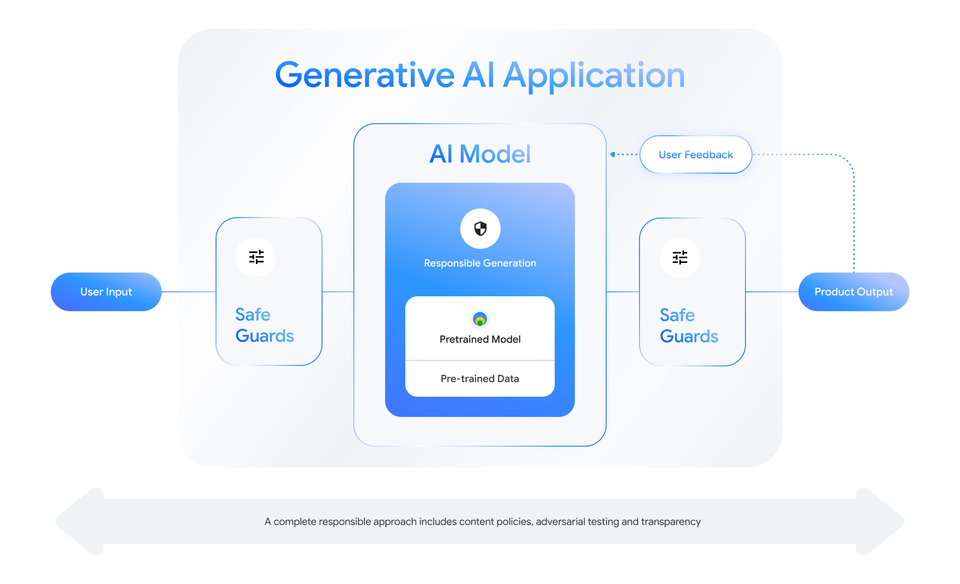

젬마는 구글의 새로운 '책임감 있는 생성 AI 툴킷(Responsible Generative AI Toolkit-다운)'으로 더 안전한 생성 AI 애플리케이션을 만들기 위한 지침과 필수 도구를 제공한다.

또한, '네이티브 케라스 3.0(Native Keras 3.0-다운)을 통해 JAX, 파이토치(PyTorch), 텐서플로우(TensorFlow) 등 모든 주요 프레임워크에 걸쳐 추론 및 감독미세조정(SFT, Supervised Fine-Tuning)를 위한 툴체인을 제공하며, 즉시 사용 가능한 코랩(Colab-보기) 및 캐글 노트북(Kaggle notebook-보기)과 허깅 페이스(Hugging Face-다운), 맥스텍스트(MaxText-다운), 엔비디아 네모(NVIDIA NeMo-다운) 및 텐서RT(TensorRT-LLM-다운) 등과 같은 인기 도구와의 통합을 통해 젬마를 쉽게 시작할 수 있다.

아울러, 사전 학습되고 사용 방향과 목적 등에 조정된 젬마 모델은 버텍스AI(Vertex AI-열기) 및 구글 쿠버네티스 엔진(Google Kubernetes Engine, GKE-열기)에 쉽게 배포하여 노트북, 워크스테이션 또는 구글 클라우드에서 실행할 수 있다.

여러 AI 하드웨어 플랫폼에 대한 최적화는 엔비디아 GPU 및 구글이 자체 설계한 학습부터 추론까지 모든 AI 워크로드에서 성능과 비용을 최적화시키는 구글 클라우드 TPU(Tensor Processing Units) 등을 포함하여 유연한 통합을 통해 업계 최고의 성능을 제공한다 .

구글은 젬마의 사전 훈련된 모델을 안전하고 신뢰할 수 있게 만드는 일환으로 자동화된 기술을 사용하여 훈련 세트에서 특정 개인 정보 및 기타 민감한 데이터를 필터링했다. 또한, 파인 튜닝 및 '인간 피드백을 통한 광범위한 강화 학습(RLHF, Reinforcement Learning from Human Feedback)'을 사용하여 모델을 조정했다.

젬마 모델의 위험 프로필을 이해하고 줄이기 위해 레드팀, 자동화된 적대적 테스트, 위험한 활동에 대한 모델 기능 평가 등 강력한 평가를 실시했다. 이러한 평가는 모델 카드(보기)에 요약되어 있다.

한편, 구글의 젬마 사용 약관은 규모에 관계없이 모든 조직에서 무료(젬마-열기)로 책임 있는 상업적 사용 및 배포할 수 있다. 성능, 데이터 세트 구성 및 모델링 방법론에 대한 자세한 내용은 기술 보고서 '젬마: 제미나이 연구 및 기술을 기반으로 한 개방형 모델(-다운)'를 참조하면 된다.