최첨단 AI 언어모델 구글 BERT를 53분에 훈련, 2밀리 초에 추론 인퍼런스 완료...마이크로소프트 등 자사 애플리케이션에 엔비디아 언어이해 기술 채택

자연어 이해에 기반한 AI 서비스는 향후 몇 년 동안 기하급수적으로 성장할 것으로 예상된다. 실제로, 주니퍼리서치(Juniper Research)는 디지털 음성 비서만의 사용건수가 향후 4년 내에 25억에서 80억으로 증가할 것으로 예측했다. 또한, 가트너(Gartner)는 2021년까지 모든 고객 서비스 상호작용의 15%가 AI로 완전히 처리되고, 2017년도 대비 400% 증가할 것으로 예측하기도 했다.

최첨단 AI 언어모델 중 하나인 구글 버트(Bidirectional Encoder Representations from Transformers, 이하 BERT)를 한 시간 내에 훈련시키고, 2밀리초(ms) 만에 AI 인퍼런스를 완료한 최초의 모델인 실시간 대화형 인공지능(AI)을 통해 기업이 고객과 보다 자연스럽게 소통할 수 있는 언어이해 모델을 13일(현지시각) 엔비디아( CEO 젠슨 황)가 발표했다.

대화형 AI 서비스는 몇 년 동안 제한적으로 존재해왔다. 현재까지 엄청나게 방대한 AI 모델을 배치하는 것이 불가능해 챗봇, 지능형 개인 비서, 검색 엔진 서비스가 인간 수준의 이해력 갖춘 채로 작동되기는 매우 어려웠다. 엔비디아는 AI 플랫폼에 핵심 최적화 기능을 추가해 이러한 문제를 해결했으며, AI 훈련과 인퍼런스를 기록적인 속도로 수행하고, 현재까지 가장 방대한 언어 모델을 구축한 것이다.

이 획기적인 성능 수준을 통해 개발자는 전세계 수억 명의 소비자가 사용할 수 있는 대규모 애플리케이션용 최신 언어이해 기능을 사용할 수 있다.

마이크로소프트(Microsoft)와 세계에서 가장 혁신적인 몇몇 스타트업을 포함한 기업들은 초기부터 엔비디아를 채택해 성능 향상을 확인했다. 이들은 엔비디아 플랫폼을 활용해 자사의 고객을 위해 매우 직관적이고 즉각적인 반응형 언어 기반 서비스를 개발하고 있다.

엔비디아 응용 딥러닝 리서치(Applied Deep Learning Research) 부사장 브라이언 카탄자로(Bryan Catanzaro)는 “대화형 언어 모델은 자연어용 AI를 혁신시키고 있다. 이는 우리가 예외적으로 어려운 언어 문제를 해결하도록 도와주고 있다”며 “엔비디아는 이러한 모델을 가속화하는 획기적인 작업을 통해 이전에는 상상도 못했던 방식으로 고객을 돕고 이들을 기쁘게 할 수 있는 새로운 첨단 서비스를 만들 고 있다”고 말했다.

한편, 엔비디아는 이 새로운 시대를 선도하기 위해 핵심 최적화를 통해 AI 플랫폼을 미세하게 조정했다. 다음은 엔비디아가 자연어 성능과 관련해 기록한 세 가지 성과로 ▷가장 빠른 훈련을 꼽을 수 있다. 세계에서 가장 진보된 AI 언어모델 중 하나인 BERT의 가장 방대한 버전을 수행한다. 1,472개의 엔비디아 V100 GPU를 실행해 924개의 엔비디아 DGX-2H™ 시스템을 사용하는 엔비디아 DGX 슈퍼POD(DGX SuperPOD)를 통해 며칠이 소요되던 BERT-라지(BERT-Large)의 훈련 시간을 53분으로 단축했다.

또한 ▷가장 빠른 인퍼런스로 엔비디아 텐서RT(TensorRT™)를 사용하는 엔비디아 T4 GPU를 통해 엔비디아는 BERT-베이스 스쿼드(BERT-Base SQuAD) 데이터세트를 단 2.2ms 초만에 인퍼런스했으며, ▷가장 방대한 모델로 엔비디아 리서치는 점점 더 방대한 모델을 요구하는 개발자의 요청에 부응해 BERT에 사용되는 기술 빌딩 블록(building block)과 점점 더 늘어나는 다른 자연어 AI 모델을 기반으로 세계 최대 언어모델을 구축하고 훈련시켰다. 엔비디아의 맟춤형 모델은 83억 개의 매개변수를 가졌으며, BERT-라지 크기의 24배다.

-참고자료-

AI 최적화 기능 제공(링크포함)

엔비디아는 개발자들이 대화형 AI에서 이러한 혁신을 달성하는 데 필요한 소프트웨어를 최적화했다.

파이토치(PyTorch)를 사용한 엔비디아 깃허브(GitHub) BERT 트레이닝 코드

NCC모델 스크립트 및 텐서플로우(TensorFlow)용 체크포인트

깃허브의 텐서RT 최적화 BERT 샘플

더 빠른 트랜스포머(Transformer): C++ API 텐서RT 플러그인 및 텐서플로우 OP

BERT(훈련 및 인퍼런스)용 AMP를 지원하는 MXNet 글루온-NLP(Gluon-NLP)

AI Hub의 텐서RT 최적화 BERT 쥬피터(Jupyter) 노트북

메가트론LM(MegatronLM): 대규모 트렌스포머 모델 훈련을 위한 파이토치 코드

엔비디아 BERT 추론은 인기 저장소 허깅 페이스(Hugging Face)에 최적화된 버전이다.

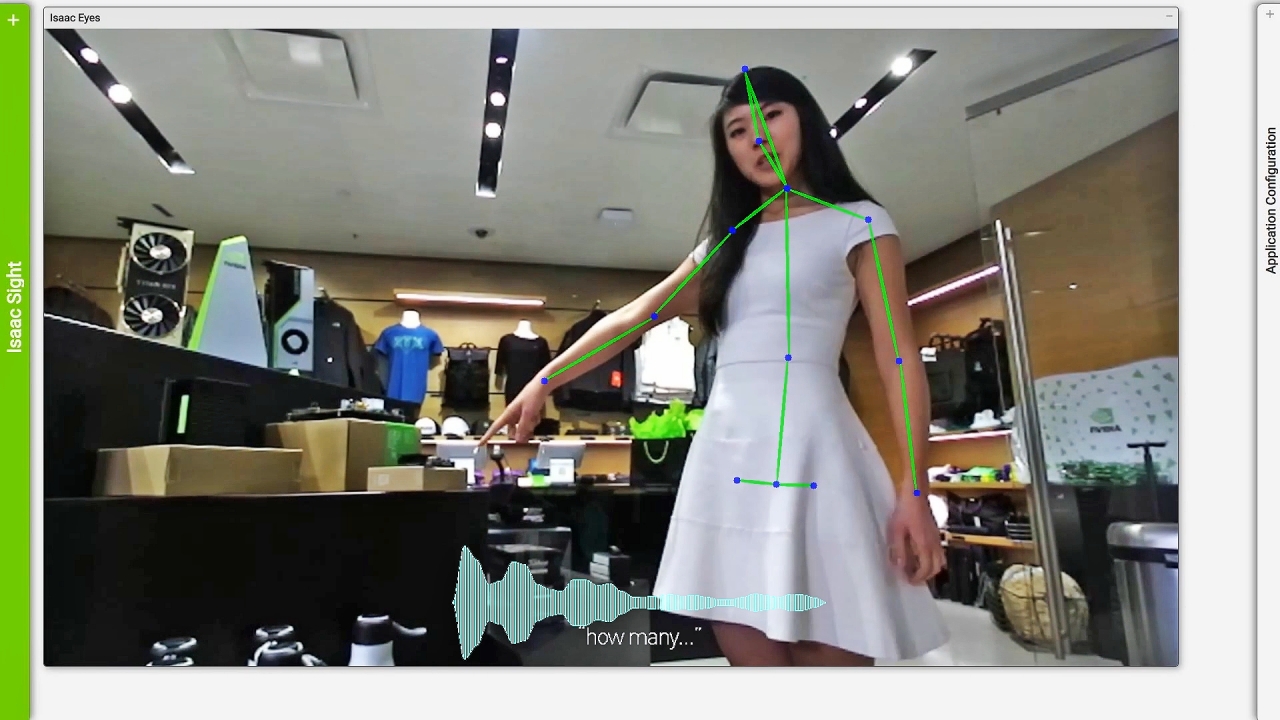

엔비디아 비디오: 대화형 AI의 다음 단계

엔비디아 개발자 블로그: 텐서RT와 BERT를 통한 실시간 자연어 이해

엔비디아 응용 딥 러닝 블로그: 메그트론LM: GPU 모델 병렬처리를 사용해 10억 개 이상의 매개변수 언어 모델 훈련