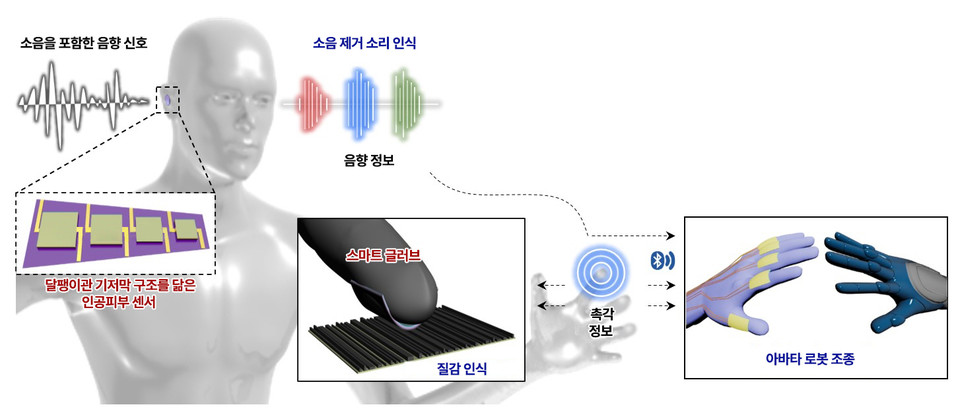

소리·촉감·동작 모두 전달하는 HMI 기술로 아바타 로봇 컨트롤, 일정 주파수에서 작동하는 로봇 손 시스템, 가상현실, 증강현실, IoT 등의 분야에서 응용될 것으로 기대

소리를 들을 수 있는 인공피부로 로봇을 조종하는 인터페이스 기술이 도래됐다.

로봇이 인공피부를 통해 물질의 촉감을 구별하며, 소리를 인식해 명령을 수행하는 기술이다. 사람의 동작까지 그대로 따라 할 수 있다. 인공지능(AI), 메타버스, 아바타 로봇 시대에 꼭 맞는 기술로 주목받고 있다.

UNIST(총장 이용훈) 고현협(에너지화학공학과)·김재준(전기전자공학과) 교수팀은 사람 동작, 촉감, 소리 등을 모두 인식해 기계에 전달할 수 있는 사람-기계 인터페이스(Human-Machine Interface, HMI)를 개발했다.

연구팀은 “버튼이나 키보드를 누르는 대신 정보를 직관적으로 기계에 전달하는 방식의 사람-기계 인터페이스”라며 “센서가 얇고 부착 가능해 다양한 가상현실 (VR), 증강현실 (AR), 사물 인터넷 (IoT) 기술에 쓸 수 있을 것”이라고 기대했다.

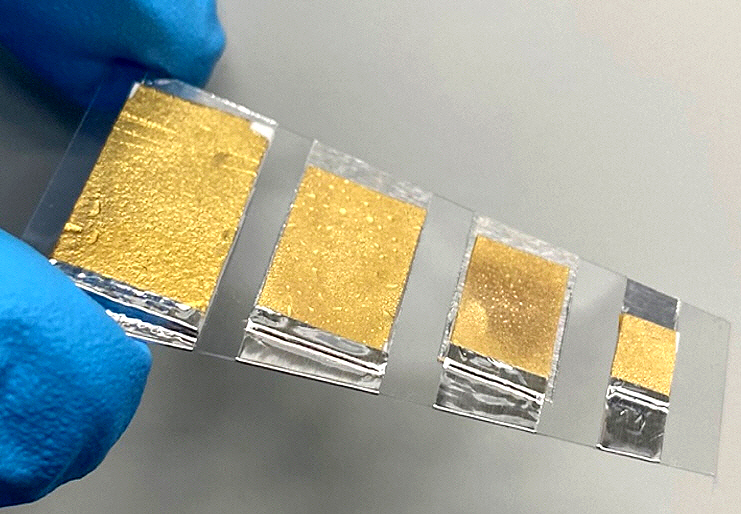

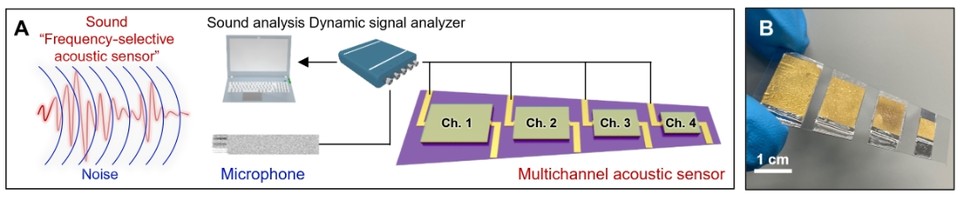

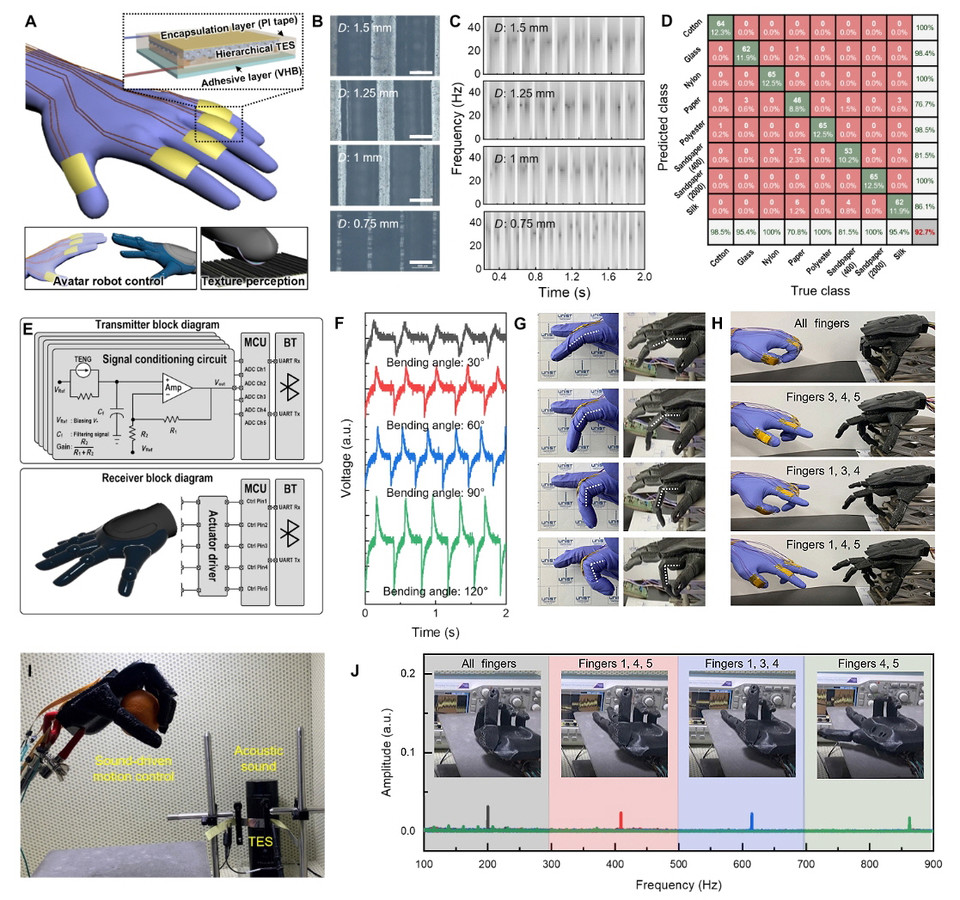

이 인터페이스는 귀의 달팽이관 구조(basilar membrane, 기저막)를 모방한 인공피부 센서를 기반으로 한다. 기저막은 두께와 너비, 단단함 정도가 부위별로 달라 소리를 주파수별(두께와 탄성율의 차이로 공진 주파수가 달라지는 현상)로 구분해 받아들 수 있는 원리를 응용했다. 또 센서 내부 구조를 특수하게 설계해 기존 평면 형태 센서보다 압력 민감도가 최대 8배 향상됐다.

음성 및 텍스처 인식 분석에서는 어떤 물질을 만지거나 말할때 물질이나 음성별로 다른 주기적인 신호특성을 나타내고 있다. 이러한 센서에서 나온 신호를 주파수 정보로 변환한뒤 목소리의 주인은 누구다 혹은 이 물질은 어떤것이다 라는걸 찾을수 있도록 미리 실험값들을 인공지능에 학습 시켜서 패턴을 찾을 수 있도록 하였다.

특히, 외부 소음 환경에서도 머신러닝을 통해 95% 정확도로 사람 목소리만 인식 가능해 소음 제거 기능을 탑재한 마이크로도 쓸 수 있다. 사용된 인공신경망(ANN) 모델은 입력 레이어용 노드 6개, 은익 레이어용 노드 10개, 출력 레이어용 노드 2개로 구성되었으며, 최소 120개의 샘플이 ANN을 훈련하는데 사용됐다.

인식 주파수 대역폭도 45 ~ 9,000 Hz(헤르츠)로 사람의 심전도 신호 (0.5 ~ 300 Hz), 근전도 신호 (50 ~ 3,000 Hz), 심음도 신호 (20 ~ 20,000 Hz), 목소리 (100~400 Hz) 와 같은 생체 신호를 모두 인식할 수 있다.

센서의 이러한 특성 덕분에 사람의 동작처럼 느리게 반복되는 저주파 신호뿐만 아니라 빠르게 진동하는 소리, 촉감 같은 고주파 신호도 낮은 신호 대 잡음비로 기계에 모두 전달할 수 있다.

연구팀은 이 센서를 활용한 아바타 로봇 손 제어 기술, 스마트 햅틱 장갑 같은 응용 기술을 선보였다. 소리로 아바타 로봇 손을 조종하는 시연에서는 주파수를 바꿔 로봇 손의 손동작을 조종할 수 있었다.

또한 사용자가 스마트 햅틱 장갑을 끼고 움직이면 아바타 로봇 손이 사용자의 손 움직임을 그대로 따라 했으며, 유리, 종이, 실크 등 8가지 다른 물질의 질감도 93% 정확도로 인식했다.

이번 연구는 미국과학협회(AAAS)에서 발행하는 세계적인 권위지 사이언스 (Science) 의 자매지인 사이언스 어드밴시스(Science Advances)에 '듀얼 모드 동적·정적 인간-기계 인터페이스를 위한 주파수 선택적 음향 및 햅틱 스마트 피부(requency-selective acoustic and haptic smart skin for dual-mode dynamic/static human-machine interface-다운)' 란 제목으로 25일(현지시각) 자로 게재됐다.