'챗GPT(ChatGPT)'가 정치적으로 편향되거나 극단적으로 공격적이거나 서로 다른 방식의 결과 등의 최근 이슈를 인정하고 이를 보완하는 새로운 버전을 개발하고 있으며, 앞으로 몇 달 안에 출시한다고 16일(현지시간) 밝혔다.

특히, 오픈AI는 최근 제기된 다양한 우려 사항을 인정하고 이를 해결하고자 하는 시스템의 실제 한계를 발견했다고 밝혔다. 또한 시스템과 정책이 함께 작동하여 ChatGPT에서 얻는 결과를 형성하는 방법에 대한 몇 가지 오류도 확인했다.

이에 대한 개선 방안으로 ▷ChatGPT의 행동이 어떻게 형성되는지 ▷ChatGPT의 기본 동작을 개선하기 위한 방법 ▷더 많은 시스템 사용자 지정을 허용 ▷ 의사 결정에 대해 더 많은 대중의 의견을 얻는 것 등을 꼽았다.

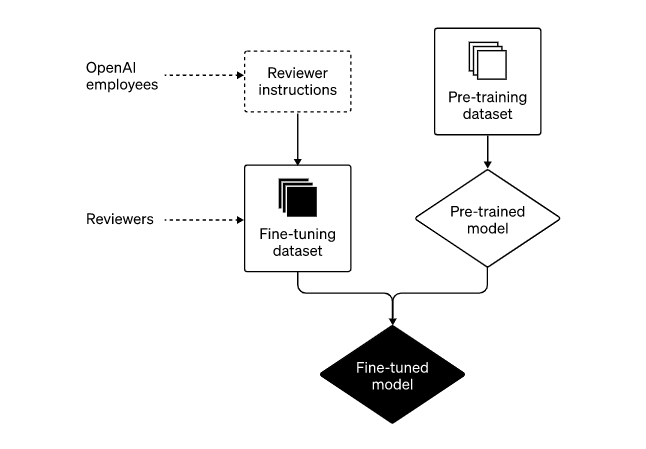

ChatGPT는 일반 소프트웨어와 달리, 거대한 신경망이다. 그들의 행동은 명시적으로 프로그래밍되지 않고 광범위한 데이터에서 학습된다. 완벽한 비유는 아니지만, 그 과정은 일반적인 프로그래밍보다는 '개를 훈련시키는 것'과 더 유사하다. 모델이 많은 인터넷 텍스트(및 광범위한 관점)에 노출됨으로써 알려지며, 문장에서 다음 단어를 예측하는 방법을 배우는 초기 "사전 훈련" 단계가 먼저 시작된다. 이어서 모델을 "미세 조정"하여 시스템 동작을 좁히는 두 번째 단계가 이어진다.

그러나, 이 과정은 불완전하다. 때때로 미세 조정 프로세스는 오픈AI 의도(안전하고 유용한 도구를 생산)와 사용자의 의도(지정된 입력에 응답하여 유용한 출력을 얻는 것)에 미치지 못한다. 특히 AI 시스템의 능력이 향상됨에 따라 AI 시스템을 인간의 가치에 맞게 조정하는 방법을 개선하는 것이 최우선 과제이다.

이에 오픈AI의 해결 방안으로 AI 시스템 동작의 맥락에서 이러한 목표를 달성하기 위해 최소한 아래 세 가지의 구성 요소가 필요하다고 밝혔다.

첫 번째, 기본 동작을 개선. 이를 위해 연구 및 엔지니어링에 지속적으로 투자하며 ChatGPT가 다양한 입력에 반응하는 방식에서 눈에 띄는 편견과 미묘한 편견을 모두 줄이고자 노력하고 있으며, 현재 ChatGPT는 어떤 경우에는 거부해서는 안 되는 출력을 거부하기도 하고, 또 어떤 경우에는 거부해야 할 때 거부하지 않는 경우도 있다. 오픈AI는 이 두 가지 측면 모두 개선이 가능하다고 밝혔다.

또한 시스템 "구성(Making Things Up)"과 같은 시스템 동작의 다른 차원에서도 개선의 여지가 있다. 이러한 개선에는 사용자의 피드백이 매우 중요하다고 밝혔다.

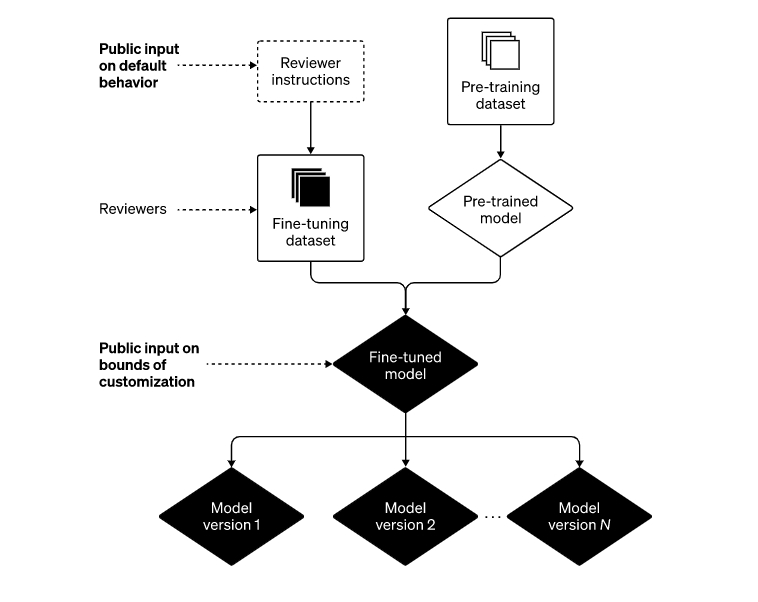

두 번째, 광범위한 범위 내에서 AI의 값을 정의. AI가 개개인에게 유용한 도구가 되어야 하며, 따라서 사회가 정의한 한계까지 각 사용자가 커스터마이징할 수 있어야 한다. 따라서 사용자가 쉽게 동작을 커스터마이징할 수 있도록 ChatGPT의 업그레이드를 개발 중이라고 밝혔다.

이는 다른 사람들(오픈AI 포함)이 강력히 반대할 수 있는 시스템 출력을 허용하는 것을 의미한다. 커스터마이징을 극단적으로 허용하면 기술을 악의적으로 사용하거나 사이코패스 AI가 등장할 위험이 있기 때문에 적절한 균형을 맞추는 것은 어려운 일이다.

따라서 시스템 동작에는 항상 어느 정도 한계가 있다. 문제는 그 한계가 무엇인지 정의하는 것으로 이러한 모든 결정을 자체적으로 내리거나 단일의 모놀리식 AI 시스템을 개발하려고 한다면, "과도한 권력 집중을 피한다"는 약속을 지키지 못할 것이라고 밝혔다. 즉, 새로운 버전에도 어느 정도 제한이 있을 것임을 분명히 한 것이다.

세 번째, 기본값과 하드 바운드에 대한 대중의 의견 수렴. 과도한 권력 집중을 피하는 한 가지 방법은 ChatGPT와 같은 시스템을 사용하거나 영향을 받는 사람들에게 해당 시스템의 규칙에 영향을 줄 수 있는 권한을 부여하는 것이다.

오픈AI는 기본값과 하드 바운드에 대한 많은 결정이 집단적으로 이루어져야 한다고 생각하며, 실제 구현은 어려운 일이지만 가능한 한 많은 관점을 포함하고자 한다. 이를 위해 우선 레드팀이라는 형태로 기술에 대한 외부의 의견을 구하고 있으며, 특히 중요한 교육 분야에서의 대중의 의견을 구하기 시작했다고 밝혔다.

아울러 시스템 동작, 공개 메커니즘(예: 워터마킹) 및 배치 정책과 같은 주제에 대한 대중의 의견을 더 광범위하게 요청하기 위한 시범 노력의 초기 단계에 있다. 또한 안전 및 정책 노력에 대한 제3자 감사를 수행하기 위해 외부 기관과의 파트너십을 모색하고 있다고 밝혔다.

결론적으로 위의 세 가지 빌딩 블록을 결합하면 인공지능 ChatGPT가 어디로 향하고 있는지에 대한 아래와 같은 결과를 얻을수 있다고 밝혔다.

마지막으로 오픈AI는 "저희는 ChatGPT 사용자 커뮤니티와 저희의 책임에 대한 대중의 경계심에 감사드리며, 앞으로 몇 달 안에 위의 세 가지 영역에서 저희의 작업에 대해 더 많은 것을 공유할 수 있게 되어 기쁩니다"라고 밝혔다.

한편, 오픈AI는 공정성과 대표성, 조정에 관한 연구, AI가 사회에 미치는 영향을 이해하기 위한 사회기술적 연구 등 이러한 비전을 달성하는 데 도움이 되는 연구를 위해 연구자 액세스 프로그램(보기)을 통해 보조금을 지원받는 API 액세스를 신청할 수 있으며 연구, 얼라인먼트, 엔지니어링 등 다양한 분야의 인재를 채용(보기)하고 있다.