클라우드부터 엣지까지 가장 포괄적인 시스템 포트폴리오 공개

인공지능(AI), 클라우드, 스토리지 및 5G, 엣지 등 위한 토탈 IT 솔루션의 글로벌 리더 슈퍼마이크로컴퓨터(Super Micro Computer. 이하, 슈퍼마이크로)가 엔비디아의 최신 시스템 HGX H100 8-GPU(코드명 Hopper)를 탑재한 신규 GPU 서버를 출시했다.

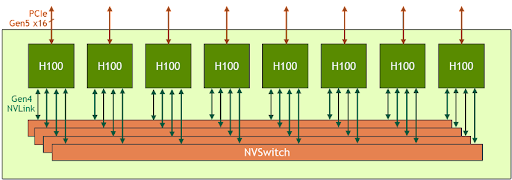

HGX H100 8-GPU는 새로운 호퍼 세대 GPU 서버의 핵심 구성 요소로 H100 Tensor 코어 GPU 8대와 3세대 NVSwitch 4개를 호스팅한다. H100 GPU마다 여러 개의 4세대 NVLink 포트가 있으며 4개의 NVSwitch에 모두 연결된다. 각 NVSwitch는 H100 Tensor 코어 GPU 8대를 모두 완벽하게 연결하는 완전 비차단 스위치다.

이처럼 NVSwitch 완전 연결 토폴로지를 구성하여 모든 H100 GPU는 다른 H100 GPU와 동시에 소통할 수 있다. 특히 이 통신은 초당 900기가바이트(GB/s)의 NVLink 양방향 속도로 실행되며, 이는 현재 PCIe Gen4 x16 버스의 대역폭보다 14배 이상 빠른 속도다.

슈퍼마이크로 서버는 엣지부터 데이터 센터까지 광범위한 애플리케이션 최적화 서버에 새로운 엔비디아 L4 텐서 코어(Tensor Core) GPU를 통합했다.

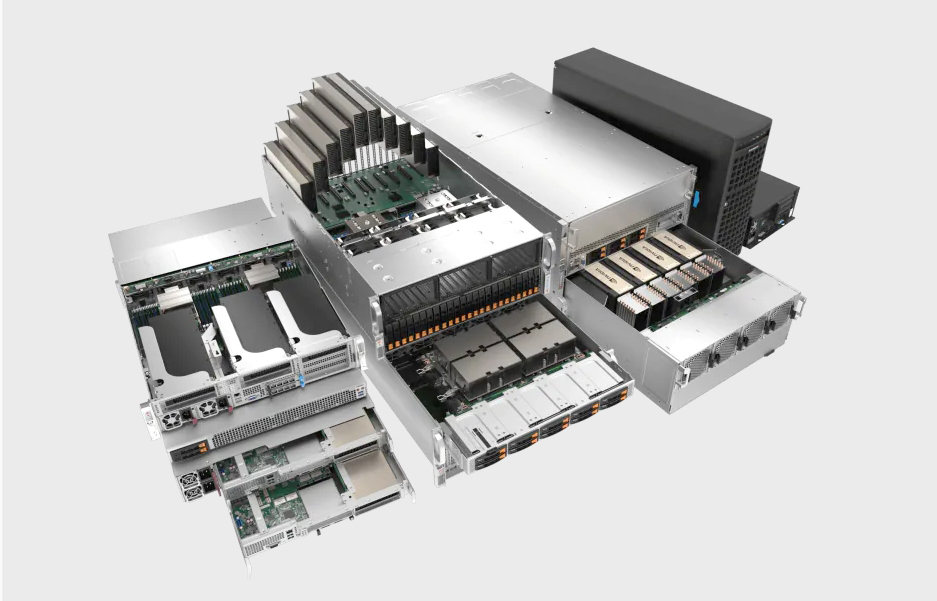

찰스 리앙(Charles Liang) 슈퍼마이크로 사장 겸 CEO는 “슈퍼마이크로는 8U, 6U, 5U, 4U, 2U 및 1U 폼 팩터 서버는 물론, 신규 엔비디아 H100 GPU의 전 제품군을 지원하는 워크스테이션 및 슈퍼블레이드(SuperBlade) 시스템 등 업계에서 가장 포괄적인 GPU 시스템 포트폴리오를 제공한다.

슈퍼마이크로의 새로운 엔비디아 HGX H100 Delta-Next 서버는 이전 세대 AI 학습 애플리케이션 대비 9배 향상된 성능을 낼 것으로 기대된다. 슈퍼마이크로 GPU 서버는 혁신적인 공기 흐름 설계를 갖춰 팬 속도, 소음 수준, 그리고 전력 소비를 낮추고 궁극적으로 총소유비용(TCO)을 감소시킨다. 또한 데이터 센터의 미래를 대비하는 고객에게 완전한 랙 규모의 액체 냉각 옵션을 제공한다”고 말했다.

가장 강력한 성능을 자랑하는 슈퍼마이크로 새 8U GPU 서버가 현재 대량 출시되고 있다. 해당 서버는 AI, 딥러닝, 머신러닝 및 HPC 워크로드에 최적화되었다. 대규모 AI 장벽을 넘어설 수 있도록 지원하는 엔비디아 HGX H100 8-GPU는 가장 빠른 엔비디아 NV링크(NVLink) 4.0 기술, NV스위치(NVSwitch) 인터커넥트, 그리고 엔비디아 퀀텀-2 인피니밴드(Quantum-2 InfiniBand) 및 스펙트럼-4 이더넷(Spectrum-4 Ethernet) 네트워킹을 사용해 최상의 GPU 간 통신을 지원한다.

또한 슈퍼마이크로는 CPU와 GPU 간 직접 연결, 단일 루트, 그리고 듀얼 루트와 더불어 표준 및 OCP DC 랙 구성의 AC 및 DC 전원을 사용하는 전면 또는 후면 I/O 모델 등 성능에 최적화된 다양한 GPU 서버 구성을 제공한다.

슈퍼마이크로 X13 슈퍼블레이드 인클로저는 20개의 엔비디아 H100 텐서 코어 PCIe GPU 또는 40개의 엔비디아 L40 GPU를 8U 인클로저에 수용한다. 뿐만 아니라, 6U 인클로저에서는 최대 10개의 엔비디아 H100 PCIe GPU 또는 20개의 엔비디아 L4 텐서 코어 GPU를 사용할 수 있다.

이 새로운 시스템은 엔비디아 AI 플랫폼의 소프트웨어 계층인 엔비디아 AI 엔터프라이즈(NVIDIA AI Enterprise) 실행에 최적화된 가속 성능을 지원한다.

한편, 새로운 서버에 탑재된 액체 냉각은 여타 GPU 서버에서도 지원된다. 슈퍼마이크로는 사무실 및 홈 오피스 환경에 적합하고 부서 및 기업 클러스터에 배포 가능한 2개의 CPU와 4개의 엔비디아 A100 텐서 코어 GPU를 탑재한 타워형 또는 랙형의 수냉식 AI 개발 시스템을 발표할 예정이다.

슈퍼마이크로 시스템은 이전 세대보다 수배 향상된 가속 성능과 에너지 효율성을 제공하는 새로운 엔비디아 L4 GPU를 지원한다. 엔터프라이즈, 클라우드 및 엣지의 AI 추론, 비디오 스트리밍, 가상 워크스테이션, 그리고 그래픽 애플리케이션에도 동일하게 적용된다. 엔비디아의 AI 플랫폼과 풀 스택 접근 방식을 통해 L4는 대규모 추론에 최적화되어 추천, 음성 기반 AI 아바타 어시스턴트, 챗봇, 비주얼 검색, 컨택 센터 자동화 등 다양한 AI 애플리케이션에서 최상의 개인화된 경험을 제공한다.

L4는 메인스트림 서버를 위한 가장 효율적인 엔비디아 가속기로서 AV1 인코딩 및 디코딩을 지원하며 최대 4배 더 높은 AI 성능, 향상된 에너지 효율성, 그리고 3배 이상 높은 비디오 스트리밍 용량 및 효율성을 지원한다. 추론 및 시각화를 위한 L4 GPU의 다양한 기능과 에너지 효율적인 소형 단일 슬롯, 로우 프로파일, 저전력 사용 72W 폼 팩터는 엣지 위치 등 글로벌 구축에 적합하다.

데이브 살바토르(Dave Salvator) 엔비디아 가속 컴퓨팅 제품 부문 이사는 “슈퍼마이크로 서버에 새로운 엔비디아 L4 텐서 코어 GPU의 탁월한 성능이 더해지면서 고객은 효율적이고 지속 가능한 방식으로 워크로드를 가속화할 수 있게 되었다. 메인스트림 배포에 최적화된 엔비디아 L4는 72W 저전력 엔벨로프에서 작동하는 로우 프로파일 폼 팩터를 제공하여 엣지에서의 AI 성능과 효율성을 새로운 차원으로 끌어 올린다”고 말했다.

슈퍼마이크로의 새로운 PCIe 가속 솔루션은 3D 세계, 디지털 트윈, 3D 시뮬레이션 모델 및 산업 메타버스의 생성을 지원한다. 슈퍼마이크로는 이전 세대의 엔비디아 OVX 시스템 지원에서 그치지 않고 4개의 엔비디아 L40 GPU, 2개의 엔비디아 커넥트X-7 스마트NIC(ConnectX-7 SmartNIC), 엔비디아 블루필드-3(NVIDIA BlueField-3) DPU 및 최신 엔비디아 옴니버스 엔터프라이즈(NVIDIA Omniverse Enterprise) 소프트웨어를 갖춘 OVX 3.0 구성을 지원한다.

한편, 한국에서 슈퍼마이크로컴퓨터 울트라 슈퍼서버를 비롯한 슈퍼마이크로(Supermicro) 컴퓨팅 전 제품군과 관련 서비스는 슈퍼솔루션(대표 김성현)이 제공하고 있다.