검출, 차선 인식, 거리 추정 등 다수의 작업을 동시에 수행해야하는 자율주행 등 AI 분야의 발전에 획기적 기여 기대돼

최근 다중 태스크 학습 연구에서는 관련성이 적은 작업들을 통합된 신경망에 같이 학습할 때 전체적인 성능이 저하된다는 문제가 있었다. 이를 해결하기 위해 기존의 연구에서는 동적 신경망 기술을 이용하여 신경망 구조를 변경하려 시도했으나, 이는 다양한 신경망 구조를 탐색하기 어렵다는 단점이 있었다.

이에 DGIST(총장 국양)의 전기전자컴퓨터공학과 임성훈 교수팀이 신경망 구조 탐색 기술을 통해 다중 태스크 딥러닝 기술을 개발했다. 이 기술은 성능의 저하 없이도 여러 작업을 동시에 수행 할수 있게 해 향후 여러 작업을 효율적으로 수행해야 하는 소형 장치나 자율주행 기술 개발 등 다양한 분야에서 활용될 것으로 기대된다.

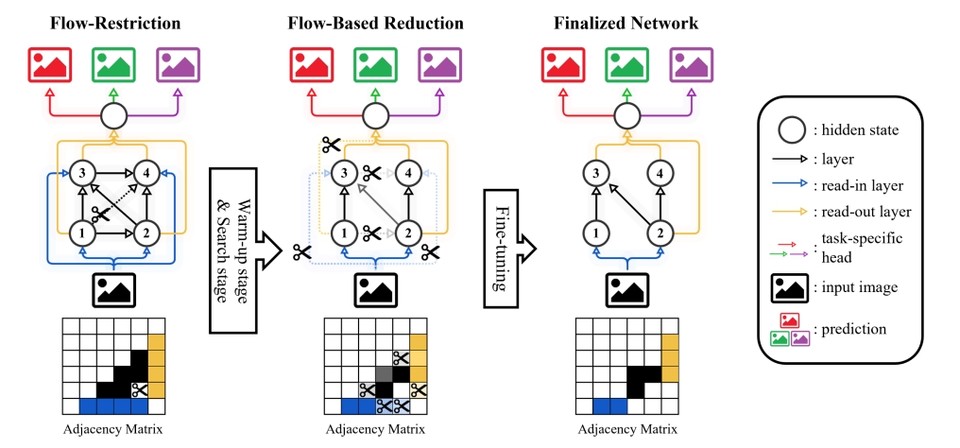

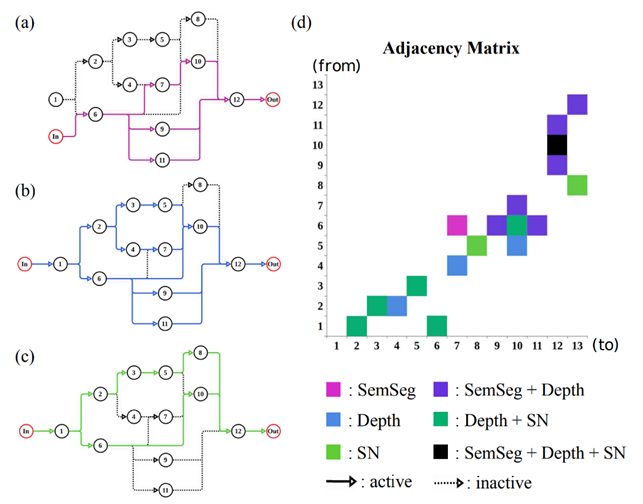

임 교수팀은 기존과 다른 관점에서 접근했다. 기존 연구가 제한된 선형적인 탐색공간에서 신경망의 탐색을 진행했다면, 임 교수팀은 기존의 선형적인 탐색공간을 확장하고, 기존의 작업들 사이의 관계성을 학습하면서 동시에 각 작업에 최적화된 신경망을 찾는 방법을 제안했다.

또한, 연구팀은 탐색한 신경망 구조의 연산 자원을 효율적으로 사용하면서 성능을 최대한 유지할 수 있는 기술을 제안했다. 이러한 연산 자원을 절감함으로써 알고리즘의 실행 속도를 효과적으로 향상시킬 수 있게 되었다. 빠른 속도로 다수의 작업을 수행해야 하는 자율주행, 로봇공학 등 향후 AI 분야의 실용적이고 광범위한 활용이 기대된다.

임성훈 교수는 “이번 연구를 통해 개발한 신경망 탐색 기법은 기존의 좁은 인공지능의 틀을 깨고 범용 인공지능에 한 발짝 다가서게 하는 기술”이라며 “향후 관련 기술을 좀 더 개선한다면 많은 분야들에 적용되어 일반화된 인공지능 기술 발전에 긍정적인 영향을 줄 것으로 기대된다.”고 말했다.

한편, 이 연구 결과는 관련 분야 최우수 국제학술대회 ‘IEEE Conference on Computer Vision and Pattern Recognition’에서 '다양한 네트워크 토폴로지에 걸친 다중 작업 학습 검색을 위한 동적 신경망(Dynamic Neural Network for Multi-task Learning Searching across Diverse Network Topologies-다운)' 란 제목으로 지난 6월 발표됐다.