데이터 처리 회로 및 CNN 기반 머신러닝 및 전이학습을 통해 사용자가 바뀌어도 몇 번의 훈련만으로 쉽게 학습이 가능하고, 심지어 마스크를 착용한 상태에서도 80퍼센트의 높은 정확도...

최근 들어, 휴머노이드 로봇을 비롯한 다양한 머신 및 시스템과 인간의 상호작용(Human-Machine Interface, HMI)기반 기술들이 활발하게 연구되고 관련 산업들이 발전됨에 따라 성능을 향상시키기 위해 감정, 기분, 느낌과 같은 인간의 정서가 점점 더 많이 고려되고 있다.

그러나 본질적으로 추상적이고 모호한 특성으로 인해 감정 정보를 정확하게 추출하고 활용하기 어려웠다. 이러한 한계를 극복하기 위해 기존에는 영상, 음성, 생체신호(Biomedical signal)와 같이 감정표현시 발현되는 표정, 발화, 신체 반응 등을 감지하는 방법들을 활용해 정밀 분석으로 어느 정도 높은 정확도로 감정 인식을 할 수 있다.

특히, 기존의 방법으로 정밀한 분석을 하기 위해 많은 장치 및 인력이 필요하다는 단점이 있기 때문에 휴대용 장치에 적용하기에는 어려움이 따랐다. 여전히 실시간으로 간단하고 휴대 가능한 특성을 갖는 감정인식 장치를 개발하는 것은 어려운 과제였다.

여기에 국내 연구진이 인공지능으로 인간의 감정을 실시간으로 인식할 수 있는 기술을 개발했다. 감정을 기반으로 서비스를 제공하는 차세대 착용형 시스템 등 다양하게 응용될 것으로 기대된다.

UNIST(총장 이용훈) 신소재공학과 김지윤 교수 연구팀은 실시간으로 감정인식을 할 수 있는 ‘착용형 인간 감정인식 기술’을 세계 최초로 개발했다.

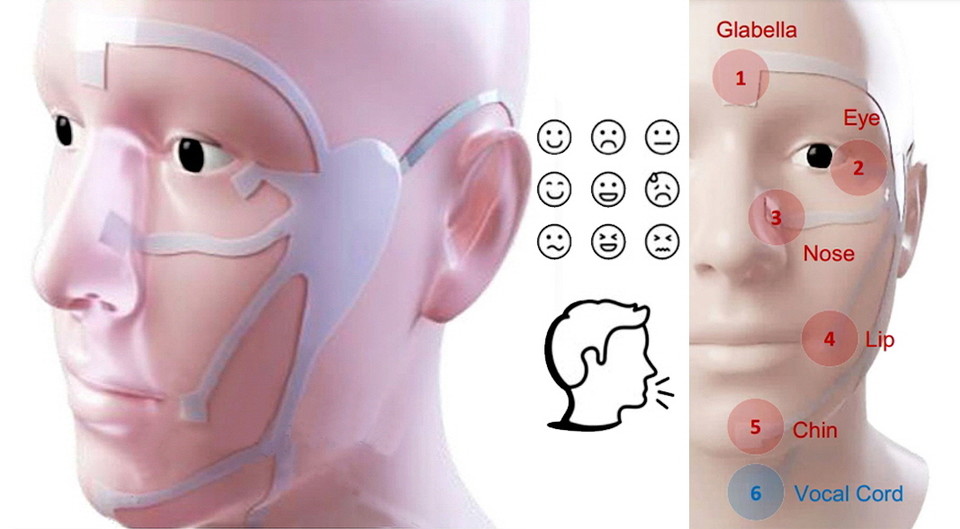

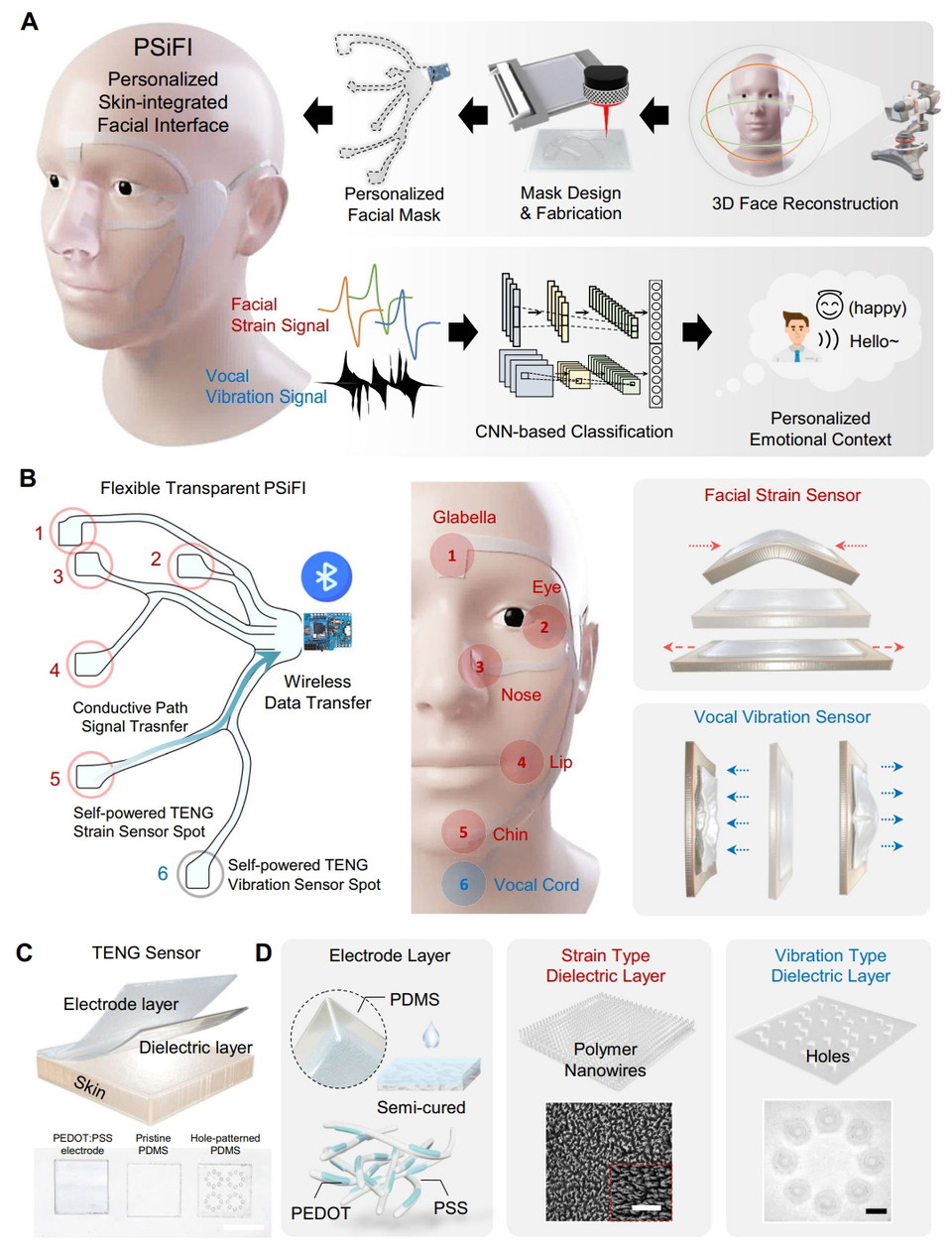

감정은 한 종류의 데이터로만은 정의하기 어렵고, 다양한 데이터를 취합해 분석해야 한다. 연구팀은 얼굴 근육의 변형과 음성을 동시에 감지하는 ‘멀티모달’ 데이터를 무선으로 전송하고 인공지능(AI)을 활용해 감정 정보로 바꿨다. 착용형 기기(Wearable Device)이기 때문에 어떤 환경에서든 감정을 분석하고 적재적소에 사용할 수 있다.

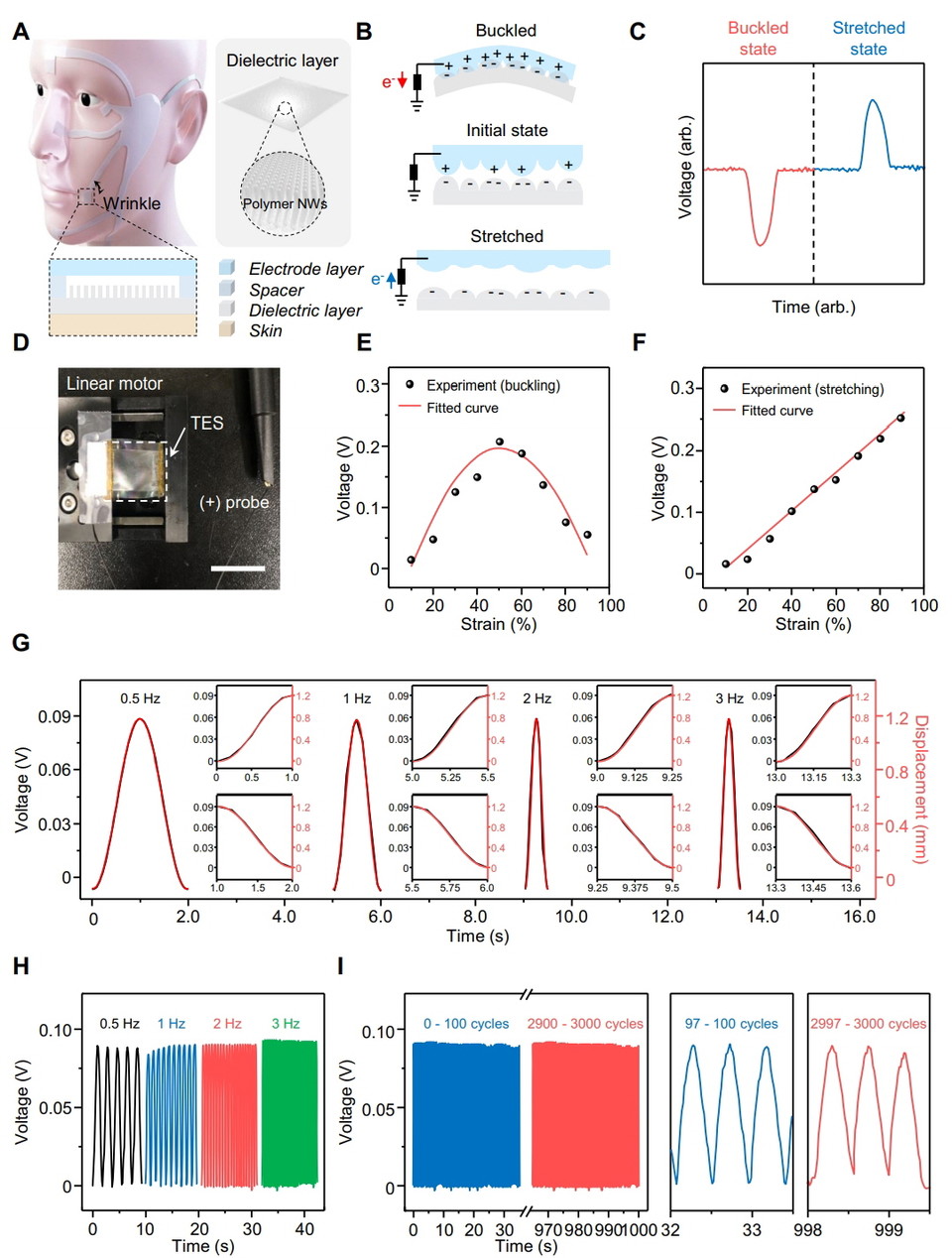

개발된 시스템은 두 물체가 마찰 후 분리될 때 각각 양과 음의 전하로 분리되는 ‘마찰 대전’현상을 기반으로 제작됐다. 자가 발전 또한 가능해 데이터를 인식할 때 추가적인 외부전원이나 복잡한 측정장치가 필요하지 않다.

김지윤 교수는 “이러한 기술을 토대로 개인에게 맞춤형으로 제공 가능한 피부통합 얼굴 인터페이스(PSiFI) 시스템을 개발했다”고 덧붙였다.

연구팀은 말랑말랑한 고체상태를 유지하는 반경화 기법을 활용했다. 이 기법으로 높은 투명도를 가진 전도체를 제작해 마찰 대전 소자의 전극에 활용했다. 다각도 촬영기법으로 개인 맞춤형 마스크도 제작했다. 자가 발전이 가능하고 유연성과 신축성, 투명성을 모두 갖춘 시스템을 만든 것이다.

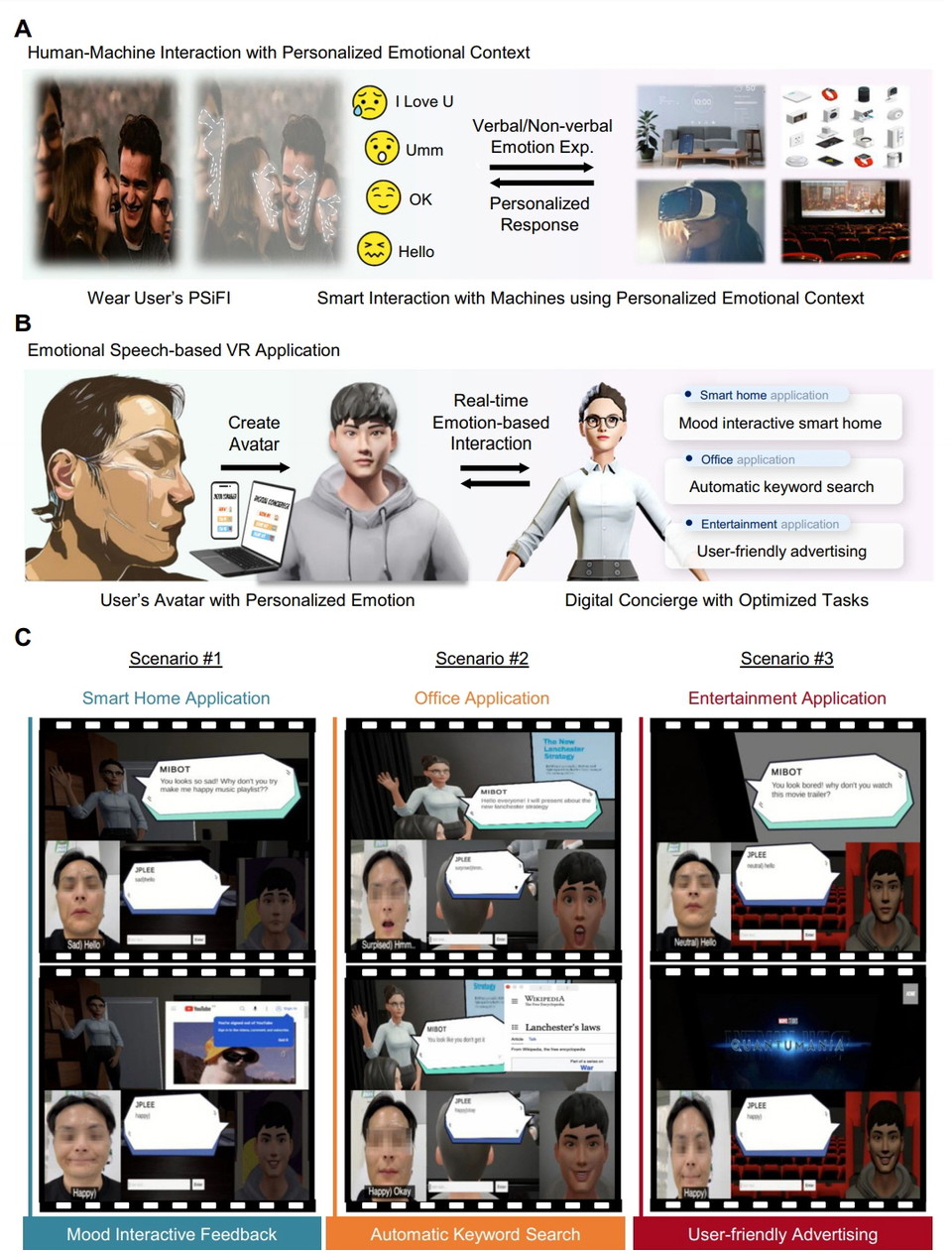

연구팀은 얼굴 근육의 변형과 성대 진동을 동시에 감지하고 이 정보들을 통합하여 실시간으로 감정을 인식을 할 수 있도록 시스템화했다. 이렇게 얻어진 정보를 이용해 사용자의 감정을 기반으로 맞춤 서비스를 제공할 수 있는 가상현실 ‘디지털 컨시어지’에 활용이 가능하다.

제1 저자 이진표 박사후 연구원은 “이번에 개발한 시스템으로 복잡한 측정 장비 없이 몇 번의 학습만으로 실시간 감정인식을 구현하는게 가능하다”며 “앞으로 휴대형 감정인식 장치 및 차세대 감정 기반 디지털 플랫폼 서비스 부품에 적용될 가능성을 보여줬다”고 말했다.

연구팀은 개발한 시스템으로 '실시간 감정 인식' 실험을 진행했다. 얼굴 근육의 변형과 목소리와 같은 멀티모달 데이터들을 수집하는 것뿐 아니라 수집된 데이터를 활용할 수 있는 ‘전이 학습(Transfer learning, TL)’도 가능했다.

개발된 시스템은 몇 번의 학습만으로도 높은 감정 인식도를 보여줬다. 개인 맞춤형으로 제작되고 무선으로 사용할 수 있어 착용성과 편리함도 확보했다.

특히, 연구팀은 개발된 감정인식 시스템을 실제 상황에서 활용하는 예시로서 무선 데이터 전송을 위한 데이터 처리 회로 및 합성곱 신경망(Convolution Neural Network, CNN)기반 머신러닝 및 전이학습을 통해 사용자가 바뀌어도 몇 번의 훈련만으로 쉽게 학습이 가능하고, 심지어 마스크를 착용한 상태에서도 80퍼센트의 높은 정확도를 보여줌으로써 성공적으로 실시간 감정인식 데모를 시연했다.

연구팀은 시스템을 VR 환경에도 적용해 '디지털 컨시어지'로 활용했다. 스마트홈, 개인 영화관, 스마트 오피스 등 다양한 상황을 연출했다. 상황별 개인의 감정을 파악해 음악이나 영화, 책 등을 추천해줄 수 있는 사용자 맞춤형 서비스가 가능함을 한 번 더 확인했다.

김지윤 신소재공학과 교수는 “사람과 기계가 높은 수준의 상호작용을 하기 위해서는 HMI 디바이스 역시 다양한 종류의 데이터들을 수집해 복잡하고 통합적인 정보를 다룰 수 있어야 한다”며 “본 연구는 차세대 착용형 시스템을 활용해 사람이 가지고 있는 아주 복잡한 형태의 정보인 감정 역시 활용이 가능하다는 것을 보여주는 하나의 예시가 될 것”이라고 전했다.

한편, 이번 연구는 싱가포르 난양공대Nanyang Technological University, NTU) 신소재공학과 Lee Pooi See 교수와의 협업으로 진행됐다. 세계적 권위의 국제학술지인 네이처 커뮤니케이션즈(Nature Communications)에 '개인화된 피부 통합 무선 안면 인터페이스를 통한 다중 모드 감정 정보 인코딩(Encoding of multi-modal emotional information via personalized skin-integrated wireless facial interface-아래첨부)'란 제목으로 지난 15일 게재됐다.